Es ist Februar 2026. Die Zeiten, in denen eine vage Idee auf einer Serviette genügte, um Risikokapital einzusammeln, sind vorbei. Was heute zählt, ist nicht mehr das Konzept – sondern die Fähigkeit, es umzusetzen. „Ideen sind billig, Ausführung ist alles”, heißt es im Silicon Valley. Der Markt beweist diesen Satz täglich.

Doch zwischen einer brillanten Idee und einem funktionierenden Produkt klafft eine Lücke, die selbst vielversprechende Projekte verschlingt. Diese Lücke hat einen Namen: Valley of Death. Es klingt dramatisch, ist aber statistisch belegbar – die meisten Innovationen sterben hier. 70 bis 80 Prozent der akademischen Forschung erreichen nie den Markt. 64 Prozent aller Projekte scheitern, weil ihre Grundannahmen nie geprüft wurden. Im Bereich Internet of Things fallen 60 Prozent der Initiativen bereits beim ersten Machbarkeitstest durch.

Was läuft schief? Und wie baut man eine Brücke über dieses Tal?

Proof of Concept ist ein beliebtes Werkzeug, um Geschäftsideen zu entwickeln. Wenn dich das Thema interessiert, kannst du gern den Hauptbeitrag „Geschäftsidee finden: Die 5 Phasen der Evolution, die du nicht überspringen kannst.” lesen, um ein Gesamtbild zu bekommen. lesen, um ein Gesamtbild zu erhalten.

Die erste Hürde: Den richtigen Partner finden

Wer eine Idee hat, aber nicht allein umsetzen kann, braucht einen Entwicklungspartner. Hier beginnt das Problem. Die Auswahl wirkt einfach: Man googelt nach Agenturen, vergleicht Angebote, unterschreibt. Doch genau das ist die Falle.

Die entscheidende Frage ist nicht, wer den Vertrag unterschreibt – sondern wer ihn vorbereitet. In vielen Unternehmen wählen Führungskräfte die Software-Partner aus: CTO, CEO, CFO. Menschen, die Budgets verwalten und Strategien entwickeln, aber nicht die tägliche Arbeit mit dem System erledigen. Das führt zu einer gefährlichen Blindheit.

Denn während die Geschäftsführung das große Ganze sieht, kennen nur die operativ Tätigen die echten Schmerzpunkte. Sie wissen, dass das alte System jeden Dienstag beim PDF-Export abstürzt. Dass es zwölf Klicks braucht, um eine einzige Rechnung zu verarbeiten – und dass davon täglich 500 anfallen. Diese Reibungsverluste bleiben den Entscheidern unsichtbar.

Das Ergebnis: Man kauft eine Lösung, die auf Folien gut aussieht, aber in der Praxis niemand nutzen will. Die Mitarbeiter erfinden Workarounds, ignorieren das neue Tool, und das investierte Geld ist verloren. Deshalb muss die Auswahl demokratisiert werden: Die Menschen, die das System täglich nutzen, müssen von Anfang an am Tisch sitzen.

Die Copy-Paste-Falle

Ein zweiter klassischer Fehler: Unternehmen, die modernisieren wollen, behandeln den Prozess wie das Kopieren von Text. Sie nehmen ihre bestehenden Abläufe – inklusive aller Fehler – und übertragen sie eins zu eins ins neue System. Das Ergebnis ist ein teures Update, das dieselben Probleme reproduziert, nur mit neuem Logo.

Statt Innovation zu ermöglichen, zementiert dieser Ansatz schlechte Prozesse in noch teurerer Software. Es ist, als würde man einen Ferrari so umbauen, dass er wie ein Traktor fährt.

Die Alternative: Man muss vor der Auswahl definieren, was das System wirklich leisten soll – nicht, was es bisher getan hat. Das erfordert Detailarbeit. Nicht „Wir brauchen ein CRM”, sondern: „Wir brauchen ein System, das Kundenanfragen in maximal zwei Klicks weiterleitet, dabei DSGVO-konform protokolliert und in Echtzeit mit unserem Lager synchronisiert.”

Der Black-Friday-Test

Ein weiteres Problem taucht oft erst spät auf: Skalierbarkeit. In Demos sieht Software immer gut aus. Ein Nutzer klickt sich durch einen kleinen Testdatensatz auf einem lokalen Server – natürlich läuft alles flüssig.

Die entscheidende Frage ist: Was passiert unter Volllast? Wenn am Montagmorgen um 9 Uhr alle gleichzeitig einloggen? Wenn bei einem Sale 100.000 Zugriffe pro Stunde eintreffen? Wenn die Datenbank nicht 500, sondern 5 Millionen Einträge verarbeiten muss?

Systeme, die unter Stress zusammenbrechen, sind offensichtlich gescheitert. Aber auch subtilere Probleme sind fatal: Wenn jede Transaktion drei Sekunden länger dauert und ein Mitarbeiter diese Transaktion 500-mal täglich ausführt, hat man die Produktivität nicht verbessert – man hat sie erstickt. Tod durch tausend Verzögerungen.

Anbieter geben solche Belastungstests selten freiwillig heraus. Man muss explizit danach fragen: Wie viele gleichzeitige Nutzer kann das System wirklich verarbeiten?

Die Datenmigration: Wo Projekte sterben

Der Transfer von Altdaten ins neue System gilt als technische Formalität. Ein Drag-and-Drop-Vorgang. Doch hier sterben Projekte – nicht verzögert, sondern endgültig.

Das Problem: Daten sind nie sauber. Ein Beispiel aus dem Gesundheitswesen: Ein Krankenhaus wechselt zu einem neuen Patientensystem. Im alten System, 20 Jahre alt, haben Ärzte das Geschlecht in ein freies Textfeld eingetragen. Das neue System hat ein Dropdown-Menü mit validierten Optionen.

Ergebnis: In der Altdatenbank stehen „M”, „männlich”, „m”, „Mann”, „F”, „weiblich”, „w”, „Frau” – plus Tippfehler. Man kann diese Daten nicht einfach importieren. Sie müssen manuell bereinigt und zugeordnet werden. Bei zehntausenden Datensätzen. Ohne diese Vorarbeit bricht der Import zusammen – oder produziert Datenmüll.

Projekte pausieren monatelang, nur um ein Adressbuch zu reparieren. Das Budget explodiert. Wer diesen Aufwand nicht vor Vertragsunterzeichnung einkalkuliert, riskiert den Kollaps.

Die Preisfalle

Es klingt verantwortungsvoll: Man holt drei Angebote ein, wählt das günstigste und spart dem Unternehmen Geld. Kurzfristig ist der Chef zufrieden.

Langfristig ist es die teuerste Entscheidung.

Denn ein gescheitertes 50.000-Euro-Projekt kostet unendlich viel mehr als ein erfolgreiches 100.000-Euro-Projekt. Warum? Weil man nicht nur die 50.000 Euro verliert, sondern auch Zeit, die Marktchance verpasst – und danach trotzdem die 100.000 Euro investieren muss, um es richtig zu machen. Man steht mit 150.000 Euro Verlust und einem halben Jahr Verzögerung da.

Billig ist teuer in der Softwareentwicklung. Fast immer.

Kontext schlägt Code

Ein weiterer kritischer Punkt: Branchenspezialisierung. Ein generischer Programmierer ist nicht dasselbe wie ein Fintech-Experte. Wer eine Gesundheits-App baut, braucht nicht nur jemanden, der Python beherrscht – sondern jemanden, der HIPAA-Compliance versteht, weiß, was geschützte Gesundheitsinformationen sind, und Patientenabläufe kennt.

Ein brillanter Entwickler ohne dieses Wissen könnte sauberen, effizienten Code schreiben, der gleichzeitig illegal ist. Etwa, weil Patientendaten auf eine Weise geloggt werden, die gegen Datenschutzbestimmungen verstößt. Plötzlich hat man keine Software, sondern ein rechtliches Haftungsrisiko.

Deshalb sollte man nicht nur den Verkäufer kennenlernen, sondern das Team, das tatsächlich entwickelt. Man sollte den Lead Developer sprechen, den Projektmanager, ihnen harte, spezifische Fragen zum Projekt stellen. Wenn ein Anbieter das verweigert, ist das ein Warnsignal. Entweder fehlt das Senior-Talent – oder man plant einen Bait-and-Switch: Das A-Team verkauft, das B-Team liefert.

Die Rechtsabsicherung: NDAs sind komplizierter, als sie scheinen

Bevor man sensible Informationen teilt, braucht man eine Geheimhaltungsvereinbarung – eine NDA (Non-Disclosure Agreement). Viele unterschreiben sie, ohne sie zu lesen. Ein Fehler.

Der Teufel steckt in der Definition dessen, was als vertraulich gilt. Wer Geheimnisse preisgibt, möchte die Definition so breit wie möglich: Alles soll geschützt sein – Notizen, Gespräche, Skizzen, E-Mails. Wer Informationen empfängt, möchte sie so eng wie möglich: Nur explizit markierte Dokumente sollen zählen. Sonst riskiert man, verklagt zu werden, weil man in einem Meeting etwas erwähnt hat, von dem man nicht wusste, dass es geheim war.

Besonders brisant sind Standstill-Klauseln. Sie kommen meist bei Übernahmen oder großen Investitionen ins Spiel. Angenommen, ein Konkurrent oder eine Private-Equity-Firma will dein Unternehmen kaufen und bittet um Einblick in die Bücher. Man öffnet alle sensiblen Finanz- und Strategiedaten.

Ohne Standstill-Klausel könnte der potenzielle Käufer diese Insider-Informationen nutzen, um eine feindliche Übernahme zu starten oder Aktien aufzukaufen. Die Klausel verhindert das: Sie dürfen die Daten sehen, aber nicht als Waffe einsetzen – meist für ein bis drei Jahre. Ohne diesen Schutz reicht man dem Vampir den Holzpflock und zeigt auf das eigene Herz.

Wenn Geld nicht reicht: Equitable Relief

Manche Schäden lassen sich nicht mit Geld reparieren. Wenn jemand ein Geschäftsgeheimnis leakt – etwa die geheime Rezeptur oder den Quellcode einer neuen KI –, hilft eine Geldstrafe Jahre später nicht. Das Geheimnis ist raus. Der Wettbewerbsvorteil ist für immer verloren.

Equitable Relief bedeutet: Man hat das Recht, sofort vor Gericht zu gehen und das Leck zu stoppen – nicht erst Jahre später Schadenersatz zu fordern. Es geht darum, die Blutung zu stoppen, nicht nur die Narben zu bezahlen.

IP-Rechte: Wem gehört, was gemeinsam entsteht?

Wenn man gemeinsam entwickelt, wird die Frage nach geistigem Eigentum schnell kompliziert. Verträge zwischen Unternehmen und Universitäten oder zwischen Firmen und Entwicklungspartnern unterscheiden mehrere Kategorien:

Background IP ist das, was man mitbringt: bestehende Technologie, Patente, Code-Bibliotheken. Das sollte nach Projektende immer noch einem gehören. Kein Vertrag sollte versehentlich dem Partner Rechte an der eigenen Grundlagentechnologie einräumen.

Foreground IP ist das, was während der Zusammenarbeit entsteht. Hier tobt der größte Kampf: Wem gehört die neue App? Mir? Dir? Beiden? Wenn wir sie gemeinsam besitzen, darf ich sie an deinen Konkurrenten lizenzieren? All das muss im Vertrag stehen.

Sideground IP ist die glückliche Entdeckung. Man arbeitet an Projekt A – einer KI zur Analyse medizinischer Bilder – und entdeckt dabei einen hocheffizienten Datenkompressionsalgorithmus. Das war nicht das Ziel, aber es ist wertvoll. Wem gehört es? Ohne klare Regelung endet man im Rechtsstreit über Zufallsfunde.

Postground IP betrifft Verbesserungen nach Projektende. Wenn ich den gemeinsam geschriebenen Code ein Jahr später allein verbessere und 10 Prozent schneller mache – schulde ich dir etwas? Haben wir Rechte daran? Man muss definieren, wann die Verpflichtung endet.

Der akademische Clash: Publizieren vs. Geheimhalten

Besonders komplex wird es bei Kooperationen zwischen Universitäten und Unternehmen. Ihre Missionen stehen in direktem Konflikt.

Universitäten existieren, um Wissen zu schaffen und zu verbreiten. Für Professoren ist die Publikation in angesehenen Fachzeitschriften Währung. Ihre Karriere, ihre Tenure hängt davon ab.

Unternehmen wollen Profit. Ihre Währung ist oft Geheimhaltung oder Patente, die ihnen einen Marktvorteil verschaffen.

Wenn ein Unternehmen mit einem Universitätsforscher eine neue Technologie entwickelt, will das Unternehmen eine NDA und alles geheim halten. Der Forscher muss einen Artikel darüber veröffentlichen, um akademisch anerkannt zu werden.

Die Lösung: Publikationsverzögerungen. Die Universität darf veröffentlichen – aber erst sechs Monate oder ein Jahr nach Projektabschluss. Das gibt dem Unternehmen Zeit, Patente anzumelden. Danach bekommt der Professor seine Publikation.

Ohne diese Absprache könnte ein Forscher versehentlich ein millionenschweres Geschäftsgeheimnis in einem Journal veröffentlichen – weil niemand ihm gesagt hat, dass er das nicht darf.

Proof of Concept, Prototyp, MVP: Warum die Unterschiede Leben retten

Viele verwenden die Begriffe austauschbar. Das ist ein Fehler. Sie beschreiben verschiedene Werkzeuge für verschiedene Phasen – und das falsche Werkzeug verbrennt Geld.

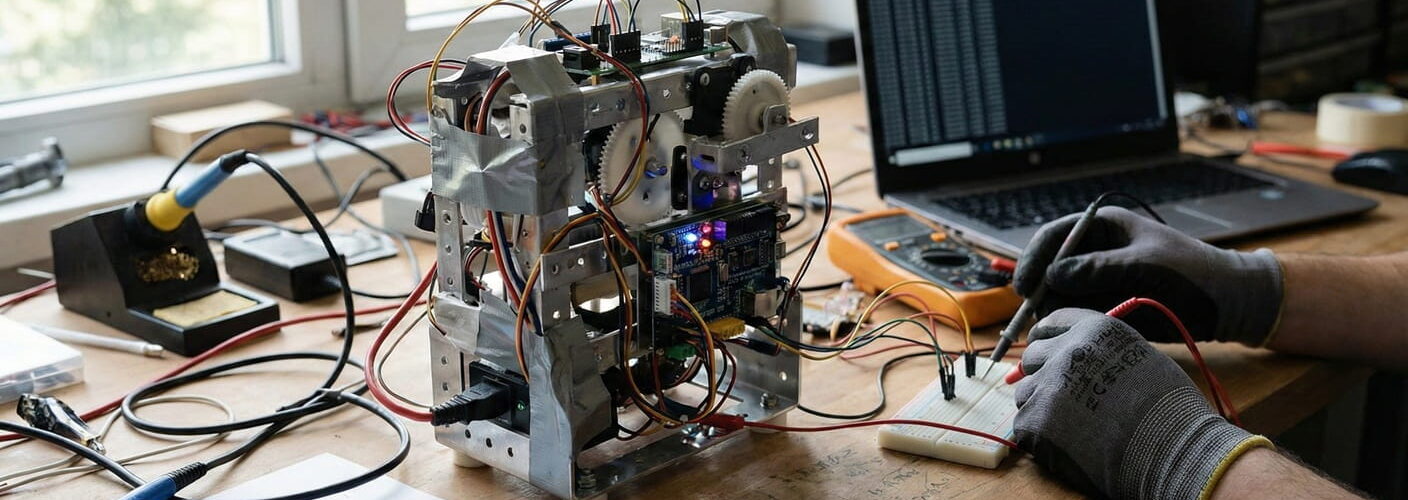

Proof of Concept (PoC) beantwortet eine einzige Frage: Ist das technisch machbar? Nicht mehr. Es ist ein Wissenschaftsexperiment. Man prüft nicht, ob es schön ist oder ob Leute es kaufen würden. Man prüft: Können wir diese spezielle Art von Daten mit dieser API unter 50 Millisekunden verschlüsseln? Die Antwort ist binär: ja oder nein.

Prototyp beantwortet: Wie sieht und fühlt sich das an? Das kann eine Reihe von Zeichnungen sein oder ein Klick-Dummy in einem Design-Tool wie Figma. Oft gibt es kein echtes Backend. Es ist eine Fassade, um Design und Nutzerführung zu testen. Ist der Button an der richtigen Stelle? Versteht der Nutzer den Ablauf?

MVP (Minimum Viable Product) beantwortet: Werden die Leute das tatsächlich nutzen oder kaufen? Es ist die einfachste Version des Produkts – aber sie muss funktionieren. Sie muss das Kernversprechen einlösen.

Die Bootanalogie macht es anschaulich: Dein Ziel ist, Menschen über einen Fluss zu bringen.

Ein PoC ist ein Stück Holz und ein paar Nägel in einem Eimer Wasser. Du testest die Physik: Schwimmt es?

Ein Prototyp ist ein detailliertes Modellboot. Es zeigt, wo die Sitze sind, wo das Lenkrad hinkommt. Man kann es potenziellen Passagieren zeigen und fragen: Macht das Layout Sinn? Aber es bringt niemanden über den Fluss.

Ein MVP ist ein Floß. Hässlich. Nur zusammengebundene Baumstämme. Die Passagiere werden nass. Aber es trägt ein, zwei Menschen sicher ans andere Ufer. Es funktioniert.

Die Pilotphase testet das Floß mit 50 echten Nutzern unter realen Bedingungen. Das finale Produkt, viel später, ist die Luxusyacht mit Kabine und Snackbar. Aber die baut man erst, wenn das Floß funktioniert und Leute bereit sind, einzusteigen.

Warum all diese Schritte?

Wegen des Risikos. 64 Prozent aller Projekte scheitern an ungeprüften Ideen. Im Bereich Internet of Things scheitern 60 Prozent bereits am PoC. Das heißt: Wenn man den PoC überspringt, setzt man Millionen auf eine Yacht, die in sechs von zehn Fällen gar nicht schwimmen wird.

Ein PoC ist eine günstige Art zu scheitern. Ein PoC kostet vielleicht 25.000 bis 60.000 Dollar. Ein vollständiger Produktausfall kostet Millionen – plus Reputationsschaden.

Dropbox vs. Google Glass

Dropbox ist das Lehrbuch-Beispiel für einen erfolgreichen PoC. Gründer Drew Houston hatte eine brillante Idee für File-Syncing. Aber die komplexe Sync-Architektur zu bauen – über Windows, Mac, Linux – hätte Monate und enormes Kapital gekostet.

Also schrieb er keine Zeile Code. Stattdessen drehte er ein Video. Drei Minuten Screencast, in dem er das Produkt vortäuschte und zeigte, wie Dateien magisch auf verschiedenen Computern erscheinen. Er postete es in einem Tech-Forum namens Digg. Die Beta-Warteliste explodierte von 5.000 auf 75.000 Menschen über Nacht.

Mit fast null Budget hatte er bewiesen, dass Menschen verzweifelt wollten, was er baute. Diese Validierung machte es leicht, Finanzierung für die harten technischen Probleme zu bekommen.

Auf der anderen Seite: Google Glass. Technologisch ein Wunderwerk. Der PoC funktionierte. Der Prototyp funktionierte. Aber Google testete nie den sozialen PoC – die menschliche Machbarkeit. Den Creepiness-Faktor. Die Tatsache, dass Nutzer als „Glassholes” bezeichnet wurden.

Sie waren so darauf fokussiert, ob sie es bauen können, dass sie nie fragten: Sollten wir es bauen? Wie wird die Gesellschaft reagieren? Sie ignorierten Datenschutzbedenken und soziale Normen. Sie bauten ein Produkt, das technisch funktionierte, aber sozial scheiterte – weil niemand ein Gespräch mit jemandem führen will, der eine Kamera im Gesicht trägt.

Die neun Essentials eines erfolgreichen PoC

Einige Punkte stechen heraus:

Beginne mit dem Problem, nicht mit der Technologie. Klassischer Fehler von Ingenieuren: „Wir wollen Blockchain für irgendetwas nutzen.” Falsch. Man beginnt mit dem Schmerz: „Wir verlieren Millionen pro Jahr durch Betrug in der Lieferkette.” Dann fragt man, ob Blockchain das richtige Werkzeug ist. Wer mit der Lösung beginnt, ist nur ein Hammer auf der Suche nach einem Nagel.

Messbare KPIs definieren. „Unser Team produktiver machen” ist kein Ziel. Es ist vage. Was ist besser? „Die durchschnittliche Bearbeitungszeit einer Rechnung von vier Minuten auf unter 30 Sekunden reduzieren” – das ist ein Ziel. Am Ende des PoC kann man messen: Haben wir die Zahl erreicht? Ja oder nein.

Throwaway-Code-Mentalität. Manche argumentieren, PoC-Code sollte immer weggeworfen werden. Die Gegenposition: Einzelne Komponenten können wiederverwendet werden. Die Wahrheit liegt in der Balance. Der Code sollte als wegwerfbar betrachtet werden, weil das Freiheit gibt. Man darf schnell coden, Abkürzungen nehmen, sich nur auf den Beweis konzentrieren – ohne sich um perfekte oder skalierbare Code-Qualität zu sorgen.

Aber: Die Erkenntnisse sind immer wiederverwendbar. Und manchmal können validierte Komponenten – ein spezifisches Sicherheitslayer, ein Algorithmus, der nachweislich funktioniert – ordentlich neu geschrieben und im MVP wiederverwendet werden. Aber: Bitte nicht den in einer Woche zusammengehackten Chaos-Code eins zu eins in die finale Banking-Anwendung kopieren.

Das akademische Tal des Todes

Nirgendwo ist der Abgrund tiefer als in der Wissenschaft. 70 bis 80 Prozent verdienstvoller Forschung erreichen nie den Markt. Warum?

Es ist eine Finanzierungslücke. Staatliche Stipendien und akademische Mittel finanzieren Grundlagenforschung – die Entdeckungsphase. Risikokapitalgeber und private Investoren finanzieren kommerzielle Produkte, die skalierungsbereit sind.

Dazwischen klafft eine Lücke. Man braucht Geld, um aus einer Doktorarbeit und Labordaten einen funktionierenden Prototypen zu bauen. Für diese Phase gibt es fast keine Finanzierung.

Die Lösung: spezifische PoC-Fonds innerhalb von Universitäten. Kanadas NSERC ist ein Beispiel. Diese Fonds sind nicht für neue Wissenschaft gedacht, sondern um existierende Wissenschaft zu prototypisieren. Die erste Version zu bauen, frühe Daten zu sammeln, zu sehen, ob es kommerziell tragfähig ist.

Aber Geld allein reicht nicht. Man braucht Mentoring. Man kann einem brillanten Wissenschaftler 50.000 Euro geben – aber der weiß nicht, wie man eine Marktanalyse macht oder einen Businessplan schreibt.

Man muss den Forscher mit einem erfahrenen Unternehmer oder einem VC verbinden. Jemand, der die erstaunliche Wissenschaft ansehen und sagen kann: „Das ist technisch brillant, aber es gibt keinen Markt dafür.” Oder: „Das ist die eine Funktion, für die Leute zahlen werden. Fokussiere all deine Energie darauf.”

Dieses Mentoring überbrückt die Kulturlücke zwischen Labor und Markt.

2026: Von Hype zu ROI

Spulen wir vor ins Jahr 2026 – ins Jetzt. Die Welt hat sich verändert. Die KI-Landschaft ist fundamental anders als 2023 oder 2024.

Das zentrale Thema: der massive Shift von Hype zu ROI. Die Party ist vorbei. Man kann nicht mehr einfach „generative KI” in die Präsentation schreiben und erwarten, dass die Aktie um 10 Prozent steigt. Der CFO sitzt mit am Tisch und stellt eine simple Frage: Zeig mir das Geld. Wie viel hat diese KI-Initiative letztes Quartal eingespart?

Der Hype wurde von der Bilanz abgelöst. Und die Technologie hat sich angepasst. Wir reden nicht mehr nur mit Chatbots. Wir arbeiten mit Agenten. Das ist der definierende Trend von 2026.

Ein Chatbot beantwortet Fragen. Ein Agent handelt. Er führt Workflows aus.

Beispiel: Ein Chatbot erklärt dir, wie man einen Versicherungsanspruch einreicht. Ein KI-Agent loggt sich ins System ein, prüft die eingereichten Fotos, checkt deine Police auf Deckung, füllt die nötigen Formulare aus und plant die Zahlung – alles autonom.

Ein Agent sagt nicht nur, was zu tun ist. Er tut es.

Du sagst dem Agenten: „Optimiere unser Inventar für das nächste Quartal basierend auf Verkaufsprognosen.” Er schreibt keinen Plan. Er loggt sich ins ERP-System ein, bestellt bei Lieferanten, storniert redundante Lieferungen, passt Produktionspläne an.

Er hat Autonomie. Aber Autonomie bedeutet Haftung. Eine neue Welt des Risikos.

Wenn ein KI-Agent eine Prognose falsch liest und 10.000 Einheiten des falschen Teils bestellt – wer ist verantwortlich? Der Anbieter? Der Nutzer? Die KI selbst?

Das ist ein rechtliches und ethisches Minenfeld. Es knüpft direkt an die Rechtsabsicherung an: Man braucht Fail-Safes. Human-in-the-Loop-Protokolle für Hochrisiko-Entscheidungen. Man kann diese Agenten nicht einfach mit der Firmenkreditkarte losschicken.

Kleine, spezialisierte Modelle

Ein weiterer Trend: Weg von Einheitslösungen, hin zu kleinen, spezialisierten Modellen. Wir hatten die Ära der Riesen-Modelle – GPT-4, Claude 3 –, die versuchten, alles für jeden zu sein.

2026 erkennen Unternehmen: Diese riesigen Generalisten-Modelle für spezifische Aufgaben zu nutzen, ist oft teuer, langsam und unsicher.

Was tun sie stattdessen? Sie bauen oder trainieren kleinere, domänenspezifische Modelle. Ein Modell, das ausschließlich auf den eigenen Rechtsdokumenten trainiert wurde. Oder auf technischen Zeichnungen. Oder auf Kundenservice-Logs.

Die Vorteile: billiger, schneller, privater. Datenschutz ist der Schlüssel.

KI-Souveränität

Das führt direkt zum nächsten Trend: KI-Souveränität. Klingt fast geopolitisch. Ist es auch – und konzernpolitisch.

Länder und große Unternehmen wollen Kontrolle über ihre eigene KI-Infrastruktur. Sie sind vorsichtig geworden, ihr kritischstes Gehirn – ihre KI-Modelle und Daten – in einem anderen Land zu hosten oder von einem einzigen Drittanbieter kontrollieren zu lassen, der seine Bedingungen ändern oder ausländischen Gesetzen unterliegen könnte.

Sie wollen den gesamten Stack besitzen. Souveräne KI: ihre Daten, auf ihrer Hardware, mit ihren Modellen, in ihrer Rechtsordnung.

Das wirkt sich direkt auf die Anbieterauswahl aus. Eine kritische Frage bei der Wahl eines KI-Anbieters 2026: Gehört mir das fine-getunete Modell? Kann ich es mitnehmen und auf meinen eigenen Servern laufen lassen, wenn ich dich verlasse?

Wenn nicht, bist du eingesperrt. Auf der tiefsten Ebene. Wenn sie das Gehirn deines Unternehmens besitzen, besitzen sie dein Geschäft.

Multimodal und verkörperte KI

Multimodal bedeutet: KI ist nicht mehr nur Text. Die Modelle verarbeiten Text, Bilder, Audio und Video gleichzeitig. Man kann ein Bild hochladen und eine Frage dazu stellen. Man kann einen Live-Videofeed vom Fabrikboden geben – visuell, akustisch, Sensordaten – und die KI versteht in Echtzeit, was passiert.

Das führt zu verkörperter KI – embodied AI. KI in einem physischen Körper. Einem Roboter. Fertigungsroboter, die einen Videofeed analysieren, einen kosmetischen Defekt an einem Produkt auf dem Fließband erkennen und es physisch entfernen – alles gesteuert von derselben Klasse multimodaler KI-Modelle.

KI mit Augen, Ohren und Händen.

Die Realität: Energie und Grenzen

Aber es gibt auch einen Reality-Check. Die physischen Einschränkungen der realen Welt holen den Hype ein. Wir stoßen an Grenzen bei Energieverbrauch und GPU-Verfügbarkeit.

Man kann nicht mehr einfach unendlich Rechenleistung auf ein Problem werfen. Die Stromrechnung für das Training und den Betrieb großer Modelle ist erheblich. Unternehmen sind gezwungen, effizient zu sein. Das richtig dimensionierte Modell für die Aufgabe zu wählen.

PoCs und Piloten müssen 2026 echte, messbare Produktivitätsgewinne zeigen – denn die Kosten für ihren Betrieb sind jetzt ein großer Posten im Budget.

Die Synthese: Von der Serviette zum Start

Fassen wir zusammen. Man beginnt mit der Serviette. Dem ersten Funken. Um diese Idee in der Welt von 2026 zur Marktreife zu bringen, muss man durch ein unglaublich komplexes Netz navigieren.

Man braucht den rechtlichen Rahmen. Detaillierte NDAs und IP-Klauseln, damit man die Idee nicht verliert, bevor man überhaupt anfängt. Man muss den Unterschied zwischen Background und Foreground IP verstehen, damit man nicht versehentlich die Zukunft des eigenen Unternehmens unterschreibt.

Dann braucht man die Anbieter-Checkliste. Einen Partner, der die neue Welt der KI-Souveränität versteht und nicht einfach versucht, das alte, kaputte System in ein neues Interface zu kopieren. Und ein Auswahlteam, das die echten Nutzer einschließt – nicht nur die Führungsebene.

Dann braucht man einen rigorosen PoC-Prozess. Man muss beweisen, dass die KI nicht nur funktionieren kann (Machbarkeit), sondern auch sollte (Wirtschaftlichkeit) – und dass sie sicher ist (Risikominderung).

Besonders wenn man diese neuen KI-Agenten baut. Man braucht nicht nur einen Proof of Concept. Man braucht einen Proof of Agency.

Das ist die Formulierung, die hängen bleibt: Ein Beweis der Handlungsfähigkeit.

Wenn 60 Prozent relativ simpler IoT-Initiativen am PoC scheiterten – und wir jetzt KI-Agenten Autonomie geben, die Fähigkeit zu handeln, nicht nur zu rechnen – sind wir dafür bereit?

Das ist eine viel höhere Messlatte. Man testet nicht mehr nur Code. Man testet Urteilsvermögen. Man testet Autonomie.

Das ist ein wenig erschreckend. Aber auch unglaublich aufregend.

Wenn man der Roadmap folgt – mit rigoroser Auswahl, starken rechtlichen Sicherheitsnetzen und einem strukturierten, mehrstufigen Validierungsprozess – kann man dieses Tal des Todes überqueren. Man kann aus der Serviette einen Start machen.

Die Herausforderung: Nimm eine konkrete Idee, die du hast. Ein neues Feature. Ein Arbeitsablauf, den du automatisieren willst. Ein vollständiges Startup-Konzept. Führe es durch den mentalen Filter: PoC versus Prototyp versus MVP.

Frag dich: Was ist die allererste Frage, die ich beantworten muss? Versuche ich zu beweisen, dass es möglich ist? Oder dass es nutzbar ist? Oder dass es wertvoll ist?

Den Unterschied zu kennen und mit dem richtigen ersten Schritt zu beginnen, könnte ein paar Millionen Euro sparen. Oder zumindest ein sehr unangenehmes Meeting mit den Investoren.

Suchvolumen: 6600

Difficulty: 32